上次《解读AI大模型,从了解token开始》一文中,我从最基础的概念“token”着手,跳过了复杂的算法逻辑,相信已经让大家建立起对AI大模型工作原理的清晰认知。

但如果仅仅只是依靠对文本的编码与数据分析,那人工智能时代应该早就到来了,为什么唯独是GPT模型的诞生开启了人工智能大模型的全盛时代?今天我将带您一探究竟,看看GPT背后的Transformer模型。

什么是Transformer?

图片

图片

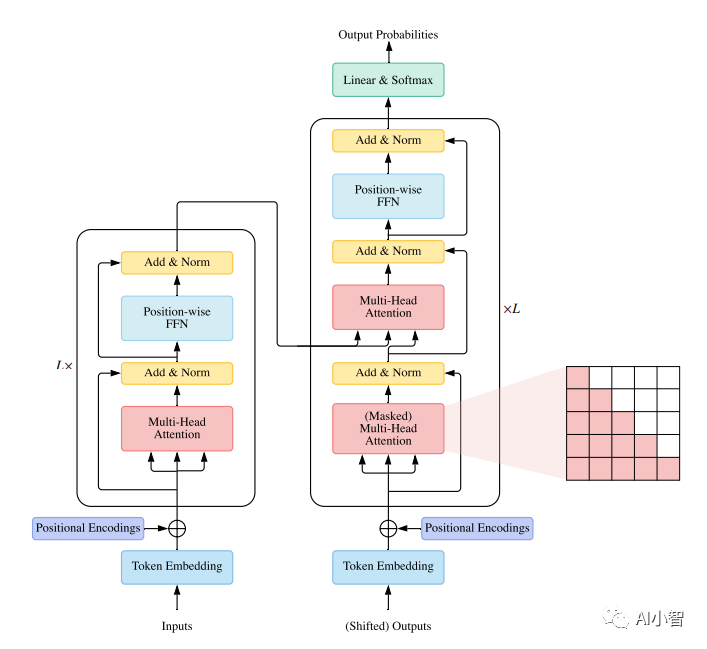

Transformer是一种新颖的神经网络架构,它在2017年由Google的研究人员提出,用于解决机器翻译等自然语言处理的任务。Transformer的特点是,它完全摒弃了传统的循环神经网络(RNN)和卷积神经网络(CNN),而是采用了一种称为自注意力机制(Self-Attention)的方法,来捕捉文本中的长距离依赖关系,提高了模型的效率和准确性。

今天本文将围绕自注意力机制,介绍Transformer 的三个主要概念,位置编码、注意力机制和自注意力机制。

位置编码(Positional Encodings)

在自然语言处理任务中,词语的顺序尤为重要。以“小明喜欢小红”和“小红喜欢小明”为例,这两句话的词语组成完全一样,仅仅是顺序不同,所表达的意思却南辕北辙。因此,语言模型必须具备把握词语顺序的能力。

然而,Transformer采用的自注意力机制是通过单元之间的相关性来进行文本序列的编码,也就是说模型本身并不能感知词语的顺序信息。为了克服这个困难,Transformer引入了一种称为位置编码(Positional Encoding)的技巧。

位置编码的思路很简单,就是在输入序列中的每个词语后面追加一个位置标记,用不同的数字表示它在句子中的位置。以句子“我爱吃苹果”为例:

我 1 爱 2 吃 3 苹果 4分享说明:转发分享请注明出处。