Mixtral 8x7B 的推出在开放 AI 领域引发了广泛关注,特别是混合专家(Mixture-of-Experts:MoEs)这一概念被大家所认知。混合专家(MoE)概念是协作智能的象征,体现了“整体大于部分之和”的说法。MoE模型汇集了各种专家模型的优势,以提供更好的预测。它是围绕一个门控网络和一组专家网络构建的,每个专家网络都擅长特定任务的不同方面

在本文中,我将使用Pytorch来实现一个MoE模型。在具体代码之前,让我们先简单介绍一下混合专家的体系结构。

MoE架构

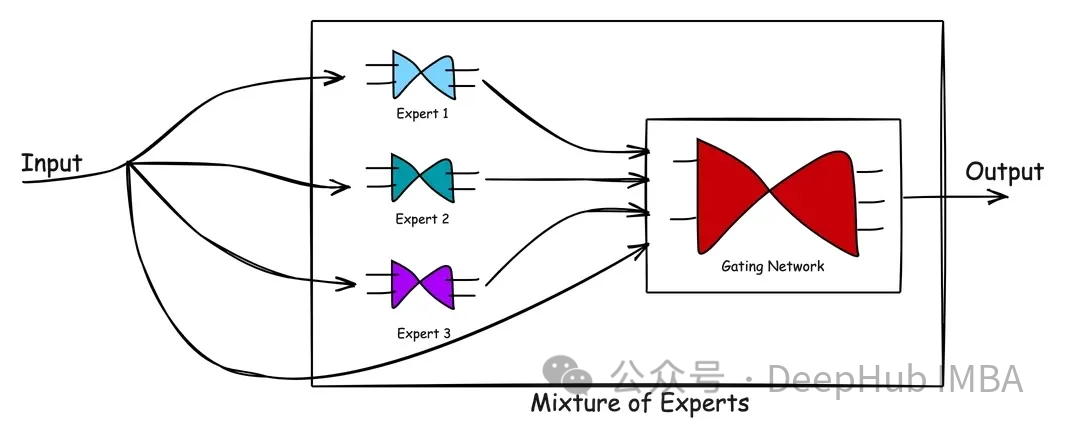

MoE由两种类型的网络组成:(1)专家网络和(2)门控网络。

专家网络:专家网络是专有模型,每个模型都经过训练,在数据的一个子集中表现出色。MoE的理念是拥有多名优势互补的专家,确保对问题空间的全面覆盖。

门控网络:门控网络充当指挥,协调或管理个别专家的贡献。它学习(或权衡)哪个网络擅长处理哪种类型的输入。经过训练的门控网络可以评估新的输入向量,并根据专家的熟练程度将处理责任分配给最合适的专家或专家组合。门控网络根据专家的输出与当前输入的相关性动态调整其权重,确保定制响应。

上图显示了MoE中的处理流程。混合专家模型的优点在于它的简单。通过学习复杂的问题空间以及专家在解决问题时的反应,MoE模型有助于产生比单个专家更好的解决方案。门控网络作为一个有效的管理者,评估情景并将任务传递给最佳专家。当新数据输入时,模型可以通过重新评估专家对新输入的优势来适应,从而产生灵活的学习方法。

MoE为部署机器学习模型提供了巨大的好处。以下是两个显著的好处。

MoE的核心优势在于其专家网络的多元化和专业化。MoE的设置能够以单一模型可能难以达到的精度处理多方面的问题。

MoE具有固有的可伸缩性。随着任务复杂性的增加,可以在不改变其他专家模型的情况下将更多专家无缝地集成到系统中,扩大专业知识的范围。也就是说,MoE可以帮助将预先训练过的专家打包到机器学习系统中。

混合专家模型在许多领域都有应用,包括推荐系统、语言建模和各种复杂的预测任务。有传言称,GPT-4是由多个专家组成的。尽管我们无法确认,但类似gpt -4的模型将通过MoE方法利用多个模型的力量来提供最佳结果。

Pytorch代码

我们这里不讨论Mixtral 8x7B这种大模型中使用的MOE技术,而是我们编写一个简单的、可以应用在任何任务中的自定义MOE,通过代码我们可以了解MOE的工作原理,这样对理解MOE在大模型中的工作方式是非常有帮助的。

下面我们将一段一段地介绍PyTorch的代码实现。

导入库:

import torch

import torch.nn as nn

import torch.optim as optim分享说明:转发分享请注明出处。